شبکههای عصبی مولد رقابتی: مروری جامع و آکادمیک

جدول محتواها

چکیده

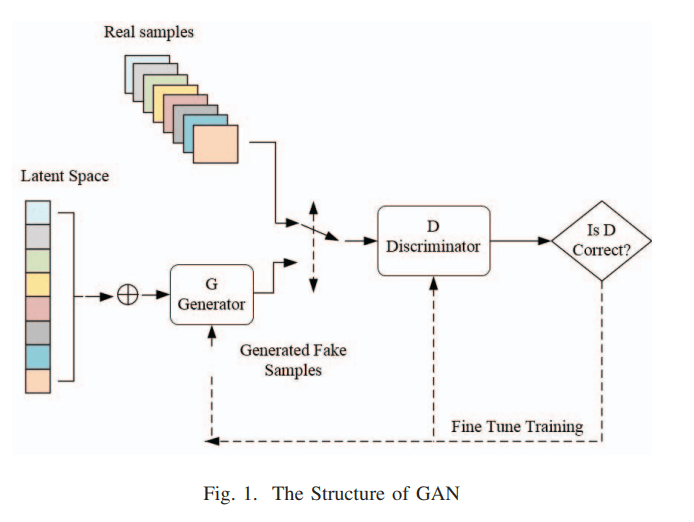

شبکههای مولد رقابتی یا Generative Adversarial Networks (GANs)، رویکردی نوین در مدلسازی مولد ضمنی هستند که تحولی بزرگ در عرصه هوش مصنوعی مولد رقم زدهاند. این ایده نخستین بار در سال ۲۰۱۴ توسط ایان گودفلو و همکارانش مطرح شد و بر پایه یک بازی رقابتی با حاصل جمع صفر میان دو شبکه عصبی بنا شده است: شبکه مولد (Generator) که دادههای مصنوعی تولید میکند و شبکه تمایزبخش (Discriminator) که وظیفه تشخیص داده واقعی از داده ساختگی را بر عهده دارد.

وظیفه شبکه مولد تولید دادههای جدید (مانند تصاویر) است که از نمونههای واقعی قابل تشخیص نباشند. در مقابل، شبکه تفکیککننده به عنوان یک داور، مسئول تشخیص تفاوت بین دادههای واقعی و تولیدشده توسط شبکه مولد است. این رقابت پویا در نهایت به تولید دادههای مصنوعیِ فوقواقعگرا منجر میشود.

با این وجود، در مراحل اولیه، پیادهسازی این شبکهها با موانع جدی روبهرو بود؛ از جمله ناپایداری در فرآیند آموزش، فروپاشی حالت (Mode Collapse) و محوشدن گرادیانها (Vanishing Gradients). در این مقاله، بهطور دقیق به بررسی نوآوریهای مهم و راهکارهای کلیدی پرداخته میشود که به رفع این چالشها کمک کردهاند.

- شبکههای عصبی مولد رقابتی عمیق کانولوشنی (DCGANs): با بهکارگیری معماریهای پایدارتر و استفاده مؤثر از لایههای کانولوشنی، فرآیند آموزش GANها بهطور چشمگیری بهبود یافت.

- شبکههای عصبی مولد رقابتی Wasserstein (WGANs): با معرفی یک تابع هزینه جدید مبتنی بر فاصله Wasserstein، مشکل محوشدن گرادیانها تا حد زیادی برطرف شد و پایداری آموزش افزایش یافت.

- شبکههای رشد تدریجی (Progressive GANs): این معماری با آغاز آموزش از تصاویر کموضوح و افزایش تدریجی رزولوشن در طول فرایند، امکان تولید تصاویری با جزئیات و کیفیت بسیار بالا را فراهم ساخت.

افزون بر این، در این گزارش به کاربردهای گسترده GANs در زمینههایی همچون تولید تصاویر با وضوح بالا، غنیسازی دادههای پزشکی و تبدیل تصویر به تصویر پرداخته شده است. در بخش پایانی نیز، با نگاهی انتقادی به چالشهای مربوط به ارزیابی دقیق عملکرد و همچنین ابعاد اخلاقی و اجتماعی تولید محتوای مصنوعی و فوقواقعگرا، جمعبندی صورت میگیرد. این گزارش میتواند به عنوان مرجعی جامع برای پژوهشگران و متخصصانی که به دنبال آگاهی از تازهترین پیشرفتها در حوزه مدلسازی مولد هستند مورد استفاده قرار گیرد.

۱. مقدمه

۱.۱. پیشینه: چشمانداز مدلسازی مولد

مدلهای مولد گروهی از الگوریتمها هستند که با هدف درک و بازنمایی توزیع آماری یک مجموعه داده آموزشی طراحی شدهاند و این امکان را فراهم میکنند که از روی آن توزیعِ آموختهشده، نمونههای تازه و واقعگرایانه تولید شود. پیش از معرفی شبکههای عصبی مولد رقابتی (GANs)، عرصه مدلسازی مولد عمدتاً در اختیار مدلهای چگالی صریح مانند ماشینهای بولتزمن بود. این دسته از مدلها نیازمند تعریف صریح یک تابع چگالی احتمال بودند؛ امری که در عمل غالباً از نظر محاسباتی بسیار دشوار یا حتی غیرممکن محسوب میشد و بهکارگیری روشهای تقریبی و زنجیرههای مارکوف پیچیده را در فرآیند آموزش اجتنابناپذیر میکرد.

در سال ۲۰۱۴، چارچوب جدیدی توسط ایان گودفلو و همکارانش معرفی شد که اساساً این پارادایم را تغییر داد. آنها شبکههای عصبی مولد رقابتی (GANs) را پیشنهاد دادند، رویکردی نوین که روشی برای مدلسازی چگالی ضمنی ارائه میکرد.۳۱ با صرفنظر از نیاز به تعریف صریح توزیع دادهها، GANs از موانع محاسباتی روشهای قبلی، مانند نیاز به زنجیرههای مارکوف یا شبکههای استنتاج تقریبی، دوری کردند و راهی مستقیم برای مدلسازی فرآیند مولد از طریق یک بازی رقابتی و دو نفره ارائه دادند.۱ این نوآوری مسیرهای جدیدی را برای سنتز دادههای غنی و با ابعاد بالا، به ویژه تصاویر، گشود.

۱.۲. مروری بر گزارش

این مقاله مروری جامع و آکادمیک بر GANs ارائه میدهد و سیر تکامل و تأثیر این فناوری را دنبال میکند. ساختار مقاله به گونهای طراحی شده است که خواننده را از اصول بنیادین به سمت پیشرفتهترین نوآوریها و چالشها هدایت کند. بخش ۲ مبانی نظری GANs را با تعریف اجزای اصلی و اصل بازی کمینهبیشینه که آموزش آنها را هدایت میکند، تبیین میکند. بخش ۳ به تفصیل چالشهای عمدهای را که در پیادهسازیهای اولیه GANs پدیدار شدند، مانند ناپایداری در آموزش و فروپاشی مُد، تشریح میکند. بخش ۴ یک تحلیل زمانی از نوآوریهای اصلی معماری و روششناختی که این مسائل را حل کردند، ارائه میدهد. بخش ۵ کاربردهای گسترده GANs را در حوزههای مختلف بررسی و سودمندی عملی آنها را برجسته میکند. بخش ۶ به پیچیدگیهای پایدار ارزیابی عملکرد GANs میپردازد و پیامدهای عمیق اخلاقی و اجتماعی این فناوری را بررسی میکند. در نهایت، بخش ۷ یافتههای کلیدی را خلاصه و نتیجهگیریهایی را در مورد مسیر آینده تحقیقات GAN ارائه میدهد.

۲. مبانی نظری شبکههای عصبی مولد رقابتی

۲.۱. پارادایم مولد-تفکیککننده

در هستهی خود، یک شبکه عصبی مولد رقابتی (GAN) از دو شبکه عصبی مجزا تشکیل میشود: مدل مولد (G) و مدل تمایزبخش (D) که در قالب یک رقابت با حاصلجمع صفر در برابر یکدیگر رقابت میکنند.

مولد (G) یک شبکه عصبی عمیق است که بردار نویز تصادفی (معمولاً با zzz نشان داده میشود) را بهعنوان ورودی دریافت کرده و آن را به یک نمونه داده مصنوعی G(z)G(z)G(z) تبدیل میکند؛ دادهای که هدف آن تقلید از ویژگیهای آماری توزیع دادههای واقعی است. هدف اصلی مولد این است که خروجیهایی تولید کند که آنقدر واقعگرایانه و قانعکننده باشند که از دید تمایزبخش و حتی ناظران انسانی، بهعنوان داده واقعی پذیرفته شوند.

در مقابل، تفکیککننده، D، به عنوان یک طبقهبندیکننده دودویی عمل میکند. این شبکه برای تشخیص نمونههای واقعی از دادههای آموزشی اصلی و نمونههای مصنوعی تولید شده توسط مولد آموزش میبیند.۳۴ این رابطه رقابتی را میتوان به یک تیم از جاعلان (مولد) تشبیه کرد که تلاش میکنند پول جعلی تولید کنند که از پول واقعی قابل تمایز نباشد، در حالی که پلیس (تفکیککننده) برای شناسایی این جعلها کار میکند.۱ قدرت چارچوب GAN در ظرافت این رابطه رقابتی نهفته است. تفکیککننده به عنوان یک ‘تابع زیان آموختهشده’ برای مولد عمل میکند ۲، که یک سیگنال آموزشی ارائه میدهد که بسیار پیچیدهتر و پویاتر از زیانهای سنتی و دستی مانند خطای میانگین مربعات (MSE) است که تنها تفاوتهای پیکسلی را جریمه میکند و اغلب منجر به خروجیهای تار و غیرواقعگرایانه میشود.۲ با آموختن اینکه چه چیزی یک نمونه ‘واقعی’ از توزیع دادهها را تشکیل میدهد، تفکیککننده یک سیگنال بازخورد غنی و سطح بالا را فراهم میکند که مولد را به سمت تولید نتایج از نظر بصری متقاعدکننده هدایت میکند.

۲.۲. رقابت کمینه–بیشینه (Minimax)

فرآیند آموزش یک GAN بهصورت یک بازی دو نفره با حاصلجمع صفر و در قالب یک رقابت کمینه–بیشینه تعریف میشود. در این چارچوب، مولد (G) در تلاش است تا تابع هدف را کمینه کند، در حالی که تمایزبخش (D) بهطور همزمان سعی در بیشینهسازی آن دارد.

- هدف تمایزبخش این است که احتمال نسبتدادهشده به یک نمونه واقعی، یعنی D(x)D(x)D(x)، و همچنین احتمال درست تشخیصدادن نمونههای جعلی، یعنی ۱−D(G(z))1 – D(G(z))1−D(G(z))، را بیشینه کند.

- در مقابل، هدف مولد این است که این اصطلاح دوم را کمینه کند؛ به بیان دیگر، مولد میکوشد احتمال خطای D را بیشینه کرده و آن را فریب دهد.

در یک تعادل نظری کامل، توزیع دادههای تولیدشده توسط مولد (pg)(p_g)(pg) دقیقاً با توزیع دادههای واقعی (pdata)(p_{data})(pdata) منطبق میشود. در این نقطه، تمایزبخش کاملاً سردرگم خواهد شد و دیگر قادر به تمایز میان داده واقعی و داده مصنوعی نیست؛ بنابراین برای تمام ورودیها احتمال ۰٫۵ را بازمیگرداند.

قالببندی آموزش GANها بهعنوان یک بازی کمینه–بیشینه (بهجای یک مسأله بهینهسازی متداول) منبع اصلی هم قدرت نوآورانه و هم ناپایداری ذاتی آنها محسوب میشود. چنین ساختاری یک تعادل پویا و غالباً غیرهمگرا ایجاد میکند؛ بهگونهای که موفقیت یک شبکه بهطور مستقیم بر دیگری اثر میگذارد و همین امر منجر به رفتار نوسانی میشود که اغلب مانع دستیابی به یک راهحل پایدار میگردد.

۲.۳. تمایز GANها از سایر مدلهای مولد

شبکههای GAN از سایر مدلهای مولد عمیق به واسطه رویکرد بنیادین خود در تخمین چگالی متمایز میشوند. به عنوان مدلهای چگالی ضمنی، GANها میآموزند نمونههایی تولید کنند بدون آنکه نیاز به تعریف صریح تابع چگالی احتمال دادهها داشته باشند. این یک تفاوت کلیدی با مدلهای چگالی صریح مانند خودرمزنگارهای متغیر (VAEs) است که نیازمند محاسبه تابع درستنمایی یا کران پایین آن هستند.

این رویکرد ضمنی مزایای قابل توجهی دارد:

- GANها قادرند خروجیهای غنی و با ابعاد بالا تولید کنند که از طریق زیان ادراکی تمایزبخش هدایت میشوند، و بنابراین تصاویر تولیدشده از وضوح و واقعگرایی بالاتری نسبت به سایر مدلها برخوردارند.

- زمان اجرای تولید نمونه در GANها نسبت به مدلهایی مانند PixelRNN کمتر است، که موجب بهرهوری بالاتر در کاربردهای عملی میشود.

با این حال، این قدرت با یک بدهبستان همراه است:

در عین حال، به لحاظ تئوری، GANها توانایی تقریب هر توزیع احتمالی را دارند و میتوانند محدودیتهایی مانند سوگیری نتایج نهایی در VAEs را پشت سر بگذارند.

از آنجا که تابع درستنمایی صریحی تعریف نشده است، وظایفی مانند تخمین حداکثر درستنمایی برای GANها غیرممکن میشود.

۳. چالشهای اصلی در آموزش GAN

با وجود ظرافت چارچوب نظری آنها، آموزش پیادهسازیهای اولیه GANs به دلیل مجموعهای از چالشهای پایدار و به همپیوسته که پیشرفت این حوزه را متوقف کرده بود تا زمانی که راهحلهای نوآورانهای توسعه یافتند، بسیار دشوار بود.۴

۳.۱. ناپایداری در آموزش و عدم همگرایی

آموزش GANها به دلیل ذاتی رقابتی بودن فرآیند، معمولاً ناپایدار و چالشبرانگیز است. دینامیک آموزش با یک تعادل پویا مشخص میشود، جایی که مولد و تمایزبخش به طور مداوم با استراتژیهای در حال تغییر یکدیگر سازگار میشوند. این فرآیند، که توسط یک تابع هدف غیرمحدب هدایت میشود، میتواند منجر به رفتارهای غیرقابل پیشبینی شود، از جمله واگرایی و نوسانات، به جای همگرایی آرام به یک تعادل پایدار.

۳.۲. فروپاشی حالت: علل و پیامدها

فروپاشی حالت (Mode Collapse) یکی از رایجترین و جدیترین مشکلات در GANهاست. در این حالت، مولد تنها مجموعهای محدود از خروجیهای یکنواخت تولید میکند و بخشهای وسیعی از توزیع دادههای واقعی را نادیده میگیرد. این پدیده حتی در مقاله اصلی GAN تحت عنوان “سناریوی هلوتیکا” اشاره شده است. یکی از دلایل اصلی آن، عدم تعادل در نرخ یادگیری دو شبکه است: اگر تمایزبخش خیلی آهسته یاد بگیرد، مولد میتواند یک نقطه ضعف را شناسایی کرده و با تولید تعداد محدودی خروجی متقاعدکننده از آن بهرهبرداری کند. نتیجه، تولید مداوم نمونههای مشابه و کاهش تنوع دادههاست.

۳.۳. مشکل گرادیانهای محوشونده

یک پارادوکس آموزشی در GANها وجود دارد: با اینکه چارچوب GAN بر فرض یک تمایزبخش بهینه بنا شده است، رسیدن به این بهینگی میتواند به یک شکست عملی معروف به گرادیانهای محوشونده (Vanishing Gradients) منجر شود. هنگامی که تمایزبخش بیش از حد قدرتمند شود و بتواند بهطور کامل بین داده واقعی و جعلی تمایز قائل شود، سیگنال گرادیان برای مولد به صفر نزدیک میشود. این یعنی مولد بازخورد کافی برای بهبود خروجی خود دریافت نمیکند.

این مشکل ریشه در تابع زیان اصلی GAN دارد که مبتنی بر واگرایی Jensen-Shannon است. وقتی توزیع مولد و دادههای واقعی همپوشانی قابل توجهی ندارند، این واگرایی اشباع شده و گرادیانی تخت و کماطلاعات ارائه میدهد. این محدودیت بنیادین، انگیزه توسعه معماریها و توابع زیان جایگزین را ایجاد کرد تا سیگنال یادگیری پایدارتر و پیوستهتری فراهم شود.

| چالش | توضیحات | راهحلهای اصلی |

|---|---|---|

| ناپایداری در آموزش | ماهیت رقابتی فرآیند آموزش باعث نوسانات و عدم همگرایی میشود و یافتن یک تعادل پایدار بین مولد و تمایزبخش را دشوار میسازد. | Wasserstein GAN (WGAN)، Progressive GANs، محدودیتهای معماری مانند DCGANs، و نرمالسازی طیفی (Spectral Normalization) |

| فروپاشی مُد (Mode Collapse) | مولد تنها مجموعهای محدود و غیرمتنوع از خروجیها را تولید میکند و قادر به بازنمایی کامل توزیع دادههای واقعی نیست. | Wasserstein GANs، تفکیک دستهای کوچک (Minibatch Discrimination)، Unrolled GANs، Progressive GANs |

| گرادیانهای محوشونده (Vanishing Gradients) | وقتی تمایزبخش بسیار قدرتمند شود، سیگنال گرادیان برای مولد بسیار ضعیف میشود و فرآیند یادگیری متوقف میگردد. | Wasserstein GANs، جریمه گرادیان (Gradient Penalty)، نرمالسازی طیفی (Spectral Normalization) |

۴. نوآوریهای معماری و روششناختی

چالشهای موجود در آموزش GANهای اولیه، موجی از نوآوریهای سریع را بهوجود آورد که منجر به شکلگیری خانوادهای از معماریها و روشهای آموزشی تخصصی شد. این پیشرفتها با هدف افزایش پایداری، کیفیت و تنوع خروجیها طراحی شدند. در ادامه، تأثیرگذارترین این نوآوریها بررسی میشود.

۴.۱. شبکههای عصبی مولد رقابتی عمیق کانولوشنی (DCGANs): تثبیت تولید تصویر

شبکههای DCGANs که در سال ۲۰۱۵ معرفی شدند، گامی مهم در بهبود عملکرد GANها به ویژه در تولید تصویر به شمار میروند. نوآوری اصلی این معماری، جایگزینی پرسپترونهای چندلایه (MLP) در GAN اصلی با شبکههای عصبی کانولوشنی (CNNs) برای هر دو بخش مولد و تمایزبخش بود. این تغییر به طور مستقیم به ناکارآمدی MLPها در مواجهه با دادههای تصویری با ابعاد بالا و همبستگی مکانی پاسخ میداد.

علاوه بر استفاده از CNNها، چندین محدودیت معماری کلیدی برای ارتقای پایداری آموزش معرفی شد:

- جایگزینی لایههای پولینگ با کانولوشنهای گامدار (strided convolutions) در تمایزبخش و کانولوشنهای گامدار کسری (fractional-strided convolutions) در مولد.

- بهکارگیری نرمالسازی دستهای (Batch Normalization) برای تثبیت و منظمسازی فرآیند آموزش در هر دو شبکه.

- حذف تمام لایههای پنهان کاملاً متصل برای امکان ایجاد معماریهای عمیقتر.

- استفاده از توابع فعالسازی ReLU در مولد (با خروجی Tanh) و LeakyReLU در تمایزبخش.

این اصلاحات، بسیاری از مشکلات ناپایداری آموزش در GANهای اولیه را برطرف کردند و پایهای قوی و پایدار برای سنتز تصویر ایجاد نمودند؛ هرچند برخی مشکلات مانند فروپاشی مُد همچنان ممکن بود پابرجا بمانند.

۴.۲. شبکههای عصبی مولد رقابتی Wasserstein (WGANs) و فاصله Earth Mover

یک مشارکت کلیدی در پایداری GAN، شبکههای Wasserstein GAN (WGAN) بود که توسط آرجوفسکی و همکارانش در سال ۲۰۱۷ پیشنهاد شد.۴۰ WGAN اساساً تابع هدف را تغییر داد و واگرایی Jensen-Shannon مسئلهساز GAN اصلی را با فاصله Wasserstein-1، که با نام فاصله Earth Mover نیز شناخته میشود، جایگزین کرد.۴۱ این معیار، حداقل ‘کار’ مورد نیاز برای تبدیل یک توزیع احتمال به دیگری را اندازهگیری میکند و یک سیگنال زیان پیوسته و غیر اشباعشونده را حتی زمانی که توزیعها همپوشانی ندارند، فراهم میکند.۳۷ این کار ‘سیگنال یادگیری بهتری’ به مولد داد ۳۷ و ‘منحنیهای یادگیری معناداری’ را ایجاد کرد که میتوانست برای عیبیابی و تنظیم ابرپارامترها استفاده شود.۴۰

در WGAN، تفکیککننده به عنوان یک ‘منتقد’ تغییر نام میدهد.۳۷ به جای خروجی دادن یک امتیاز احتمال بین ۰ و ۱، منتقد یک امتیاز نامحدود را خروجی میدهد که مولد باید برای دادههای جعلی آن را کمینه کند و تفکیککننده باید برای دادههای واقعی آن را بیشینه کند.۲۸ برای تضمین یک تقریب صحیح از فاصله Wasserstein، منتقد باید یک محدودیت پیوستگی K-Lipschitz را رعایت کند.۳۷ در حالی که پیادهسازیهای اولیه این را با clipping وزن (Weight Clipping) اعمال میکردند، یک بهبود بعدی توسط گالراجانی و همکارانش ‘جریمه گرادیان’ (WGAN-GP) را معرفی کرد که مؤثرتر و پایدارتر است. این روش با جریمه کردن نرم گرادیانهای منتقد، محدودیت را اعمال میکند.

با وجود ظرافت نظری، تحقیقات بعدی دیدگاه دقیقتری نسبت به موفقیت WGAN ارائه دادهاند. برخی از محققان استدلال میکنند که فایده عملی ممکن است از کمینهسازی فاصله Wasserstein واقعی نباشد، بلکه از منظمسازی (Regularization) فراهمشده توسط محدودیت Lipschitz باشد که منجر به گرادیانهای هموارتر و یک فرآیند بهینهسازی پایدارتر میشود.با این حال، باید توجه داشت که فرآیند آموزش WGAN و WGAN-GP اغلب کندتر از GAN معمولی است.

۴.۳. رشد تدریجی GANs

رشد تدریجی GANs (ProGANs)، که توسط NVIDIA توسعه یافت، یک روششناسی آموزشی نوین را برای حل چالش دشوار تولید تصاویر با وضوح بالا معرفی کرد.۱۴ ایده اصلی این است که هم مولد و هم تفکیککننده به صورت تدریجی در طول آموزش رشد کنند.۱۴ آموزش با تصاویر با وضوح بسیار پایین (مثلاً ۴x۴ پیکسل) آغاز میشود و با پیشرفت فرآیند، لایههای جدید به صورت هموار ‘فید میشوند’ تا جزئیات ریزتر و وضوحهای بالاتر را مدیریت کنند.

این رویکرد با اجازه دادن به شبکهها برای کشف ساختار درشت و بزرگمقیاس دادهها قبل از تمرکز بر جزئیات ریزتر، مسئله یادگیری را ساده میکند، فرآیندی مشابه نحوه یادگیری انسانها برای طراحی یا درک جهان.این روششناسی نه تنها پایداری را با جلوگیری از شوکهای آموزشی ناگهانی که با تصاویر بزرگمقیاس همراه است، به شدت بهبود میبخشد، بلکه زمان آموزش را نیز به طور قابل توجهی کاهش میدهد.ProGANs نشان دادند که برای وظایف مولد پیچیده، روششناسی آموزش میتواند به اندازه معماری یا تابع زیان مدل حیاتی باشد، و به طور مؤثری یک مشکل دشوار را به مجموعهای از وظایف سادهتر و متوالی تبدیل میکند.این رویکرد همچنین شامل روشهایی مانند “انحراف معیار دستهبندی کوچک” (Minibatch Standard Deviation) برای تشویق تنوع بیشتر در تصاویر تولیدی است.

۴.۴. GANs شرطی و تبدیل تصویر به تصویر

چارچوب GAN اصلی یک مدل مولد غیرشرطی است، به این معنی که نمونهها را بدون هیچ کنترل خاصی بر خروجی تولید میکند.۲۰ این موضوع با معرفی GANs شرطی (cGANs) تغییر کرد، که با گنجاندن اطلاعات اضافی، یا یک ‘شرط’ (

y)، در هر دو شبکه مولد و تفکیککننده، چارچوب اصلی را گسترش میدهند.این کار تولید هدفمند و کنترلشده داده را ممکن میسازد و در توسعه تبدیل تصویر به تصویر نقش ابزاری داشته است.

۴.۴.۱. Pix2Pix: تبدیل تصویر جفتشده

Pix2Pix یک نمونه برجسته از یک cGAN است که برای وظایف تبدیل تصویر به تصویر طراحی شده و بر دادههای آموزشی جفتشده تکیه دارد، جایی که یک نگاشت مستقیم بین دامنه ورودی و خروجی وجود دارد.۳۴ مولد آن بر اساس یک معماری U-Net با ‘اتصالات پرشی’ (skip connections) است که به اطلاعات سطح پایین اجازه میدهد مستقیماً از رمزگذار به رمزگشا منتقل شوند.۴۵ تفکیککننده، که به عنوان ‘PatchGAN’ شناخته میشود، برای مدلسازی ساختارهای فرکانس بالا با طبقهبندی اصالت وصلههای تصویری کوچک به جای کل تصویر طراحی شده است.۴۶ تابع زیان، زیان رقابتی cGAN را با یک عبارت فاصله L1 ترکیب میکند، که به کاهش تار شدن و کاهش آرتیفکتهای بصری کمک میکند.۴۵

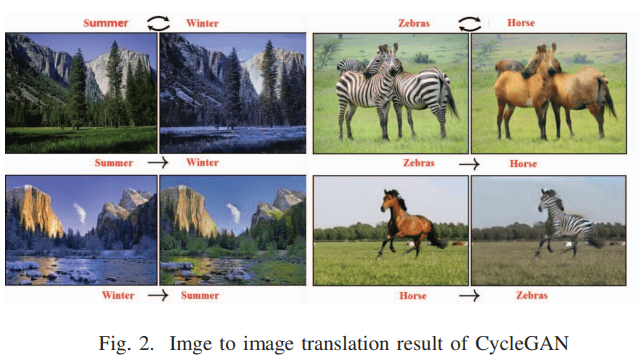

۴.۴.۲. CycleGAN: تبدیل تصویر بدون جفت

در حالی که Pix2Pix بسیار مؤثر بود، وابستگی آن به دادههای آموزشی جفتشده یک محدودیت قابل توجه برای بسیاری از کاربردهای دنیای واقعی بود.۳۴ CycleGAN این مشکل را با معرفی یک روش برای ‘تبدیل تصویر به تصویر بدون جفت’ حل کرد.۴۷ نوآوری اصلی CycleGAN ‘زیان سازگاری چرخهای’ (cycle-consistency loss) است، که این شهود را به تصویر میکشد که اگر یک تصویر از یک دامنه منبع به یک دامنه هدف تبدیل شود و سپس دوباره به عقب برگردانده شود، باید به شکل اصلی خود بازگردد.

این چارچوب دو مولد، G:X→Y و F:Y→X، و دو تفکیککننده مربوطه را آموزش میدهد.۴۸ تابع زیان کلی، زیانهای رقابتی برای هر دو مولد را با زیان سازگاری چرخهای ترکیب میکند، که نگاشت را حتی در غیاب نمونههای جفتشده نیز معنادار میکند.۱۷ این پیشرفت، طیف گستردهای از کاربردهای جدید را امکانپذیر ساخت، مانند تبدیل اسبها به گورخرها و تبدیل عکسها به نقاشی.

| نوع GAN | نوآوری(ها)ی کلیدی | مشکل(ها)ی حلشده |

| GAN اولیه | آموزش رقابتی با بازی کمینهبیشینه و زیان واگرایی Jensen-Shannon. | مدلسازی چگالی ضمنی؛ عدم نیاز به زنجیرههای مارکوف یا استنتاج تقریبی ۵۲ |

| DCGAN | استفاده از CNNs با محدودیتهای معماری خاص (مانند نرمالسازی دستهای، کانولوشنهای گامدار). | ناپایداری در آموزش و کیفیت پایین تصاویر تولیدشده توسط GANهای اولیه ۸ |

| WGAN | زیان فاصله Wasserstein-1 (فاصله Earth Mover) و محدودیت Lipschitz. | گرادیانهای محوشونده و فروپاشی مُد با ارائه یک سیگنال زیان پایدار و غیر اشباعشونده ۳۷ |

| Progressive GAN | روششناسی آموزش تدریجی، رشد شبکهها از وضوح پایین به بالا. | تولید تصاویر با وضوح بالا، ناپایداری در آموزش و همگرایی کند ۱۵ |

| Pix2Pix | GAN شرطی با مولد U-Net و تفکیککننده PatchGAN. | تبدیل تصویر به تصویر جفتشده و تبدیل معنایی به عکس ۴۶ |

| CycleGAN | زیان سازگاری چرخهای برای دادههای آموزشی بدون جفت. | نیاز به دادههای آموزشی جفتشده در تبدیل تصویر به تصویر ۴۸ |

۵. کاربردهای عملی و تأثیرات گسترده

نوآوریهای معماری و روششناختی در GANs طیف وسیعی از کاربردهای عملی را ممکن ساختهاند و آنها را به عنوان یک فناوری بنیادین با تأثیرات قابل توجه در دنیای واقعی در صنایع متعدد تثبیت کردهاند.

۵.۱. بینایی ماشین و تولید محتوا

شبکههای GAN انقلابی در حوزه بینایی ماشین و تولید محتوای دیجیتال ایجاد کردهاند و به طور گسترده در وظایف مختلف مورد استفاده قرار میگیرند:

- سنتز تصویر و ویدئو: تولید تصاویر فوقواقعگرایانه از چهرههای انسانی، مناظر و سایر اشیای غیرواقعی. این کاربردها در بازیها، تبلیغات و هنر برای خلق محتوای بصری جدید و منحصر به فرد اهمیت ویژهای دارند.

- تبدیل تصویر به تصویر (Image-to-Image Translation): تغییر تصاویر بین دامنههای مختلف، مانند رنگآمیزی تصاویر سیاه و سفید، تغییر فصل در یک صحنه، یا تولید تصاویر فوتورئالیستی از طرحها.

- فوقوضوح (Super-Resolution): ارتقای وضوح تصاویر با کیفیت پایین با افزودن جزئیات دقیق و واقعگرایانه، که به کاهش مشکلات رایج در افزایش مقیاس، مانند تار شدن و پیکسلسازی، کمک میکند.

- انتقال سبک (Style Transfer): اعمال سبک هنری یک تصویر به تصویر دیگر، به منظور خلق آثار هنری یا طراحیهای نوآورانه.

توانایی GANها در تولید تصاویر واقعگرایانه و با کیفیت بالا نتیجه مستقیم بهبود معماریها مانند DCGAN و WGAN است. علاوه بر این، توسعه GANهای شرطی (Conditional GANs)، پیششرطی حیاتی برای انجام موفق وظایف تبدیل تصویر به تصویر فراهم کرده است.

۵.۲. غنیسازی و سنتز داده

یکی از کاربردهای حیاتی GANها، تولید دادههای مصنوعی برای غنیسازی مجموعههای داده محدود است. این کاربرد به ویژه در حوزههایی که دادهها کمیاب، پرهزینه یا دشوار به دست میآیند، مانند بینایی ماشین، تشخیص گفتار و پردازش زبان طبیعی، ارزشمند است. با تولید دادههای اضافی و متنوع، GANها قادرند مجموعههای داده موجود را گسترش دهند و عملکرد و مقاومت مدلهای یادگیری ماشین را بهبود بخشند.

۵.۳. کاربردها در مراقبتهای بهداشتی و تحقیقات پزشکی

GANها در حوزه مراقبتهای بهداشتی پتانسیل عظیمی نشان دادهاند، جایی که کمبود داده و محدودیتهای حفظ حریم خصوصی چالشهای جدی ایجاد میکنند. کاربردهای اصلی شامل موارد زیر است:

- تولید تصاویر پزشکی مصنوعی: GANها میتوانند تصاویر واقعگرایانه پزشکی، مانند اسکنهای MRI، CT و X-ray، تولید کنند تا مدلهای تشخیصی آموزش ببینند، بدون آنکه حریم خصوصی بیماران به خطر بیفتد. این امر به محققان امکان میدهد مدلهای جدیدی توسعه دهند و در عین حال از مقرراتی مانند HIPAA و GDPR پیروی کنند.

- غنیسازی داده برای بیماریهای نادر: GANها قادرند نمونههای مصنوعی از شرایط نادر بسازند تا مجموعههای داده نامتعادل را متعادل کنند، که برای آموزش مدلهایی که بر پاتولوژیهای کمتر رایج هم عملکرد خوبی دارند، حیاتی است.

- تشخیص ناهنجاری: با آموزش بر روی مجموعهای از تصاویر سالم، GANها توزیع طبیعی اسکنهای پزشکی را یاد میگیرند. هر گونه انحراف از این الگو میتواند به عنوان ناهنجاری شناسایی شود و احتمالاً نشاندهنده یک بیماری یا وضعیت پاتولوژیک باشد.

| صنعت | کاربردهای اصلی | مثالها |

|---|---|---|

| بینایی ماشین | سنتز تصویر، غنیسازی داده، فوقوضوح | تولید چهرهها و مناظر واقعگرایانه انسانی؛ بهبود عکسهای با وضوح پایین؛ ایجاد دادههای آموزشی جدید برای تشخیص اشیاء |

| رسانه و سرگرمی | تولید محتوا، تولید ویدئو، انتقال سبک | ایجاد محتوای واقعگرایانه برای فیلمها و بازیهای ویدئویی؛ تولید آواتارهای جدید برای پروفایلهای آنلاین؛ تبدیل عکسها به نقاشی با سبک خاص |

| مراقبتهای بهداشتی | سنتز تصاویر پزشکی مصنوعی، غنیسازی داده، تشخیص ناهنجاری | تولید اسکنهای واقعگرایانه MRI/CT برای آموزش مدلهای تشخیصی؛ غنیسازی مجموعه دادهها برای بیماریهای نادر؛ تشخیص تومورها یا سایر پاتولوژیها |

| مالی و امنیتی | تشخیص ناهنجاری، تولید داده برای محیطهای محدود | شناسایی تراکنشهای جعلی با تشخیص الگوهای غیرمعمول؛ تولید دادههای مصنوعی برای آزمایش مدلهای امنیت سایبری |

| تعامل انسان و رایانه | هدایت خودکار کمکی، تولید تصویر از متن | پیشبینی صحنههای ترافیکی برای رانندگی خودکار؛ تولید تصاویر فوتورئالیستی از توصیفات متنی |

| سنتز سهبعدی (3D) | سنتز مدل سهبعدی از تصاویر دوبعدی | تولید مدلهای سهبعدی برای معماری، طراحی یا بازی |

۶. ارزیابی و چالشهای باقیمانده

با وجود موفقیتهای چشمگیر، GANها هنوز با چالشهای مهمی مواجه هستند که نه تنها فنی، بلکه شامل سؤالات اخلاقی و اجتماعی نیز میشوند و نیازمند توجه جدی پژوهشگران و متخصصان هستند.

۶.۱. دشواری ارزیابی GAN

یکی از اصلیترین چالشها در تحقیقات GAN، فقدان معیار جهانی، عینی و استاندارد برای سنجش کیفیت و تنوع نمونههای تولیدشده است. برخلاف وظایف یادگیری نظارتشده که برچسبهای حقیقت زمینی واضح دارند، GANها هیچ خروجی «درستی» برای مقایسه مستقیم ارائه نمیکنند. این مشکل بهطور مستقیم ناشی از رویکرد مدلسازی چگالی ضمنی است، چرا که تابع درستنمایی صریحی برای بیشینهسازی یا سنجش وجود ندارد.

معیارهای رایج ارزیابی شامل امتیاز Inception (IS) و فاصله Fréchet Inception (FID) هستند که تلاش میکنند وفاداری (واقعگرایی) و تنوع تصاویر تولیدشده را کمیسازی کنند. با این حال، محدودیتهای قابل توجهی دارند:

- IS ممکن است در شرایط فروپاشی مُد بهطور گمراهکنندهای بالا باشد، زیرا مستقیماً تصاویر تولیدشده را با توزیع داده واقعی مقایسه نمیکند.

- FID اگرچه جامعتر است، اما همچنان با محدودیتهایی مرتبط با اندازه و پیچیدگی مجموعه داده مواجه است.

به دلیل این محدودیتها، ارزیابی عملکرد GAN اغلب نیازمند بازرسی دستی و ارزیابی بصری در کنار معیارهای تقریبی ناقص است، که سنجش دقیق و عینی کیفیت خروجی را چالشبرانگیز میکند.

۶.۲. ملاحظات اخلاقی و پیامدهای اجتماعی

قدرت GANها در تولید محتوای فوقواقعگرایانه مصنوعی، یک چالش جدی کاربرد دوگانه (dual-use) ایجاد میکند که پیامدهای اخلاقی قابل توجهی دارد. یکی از بارزترین نمونهها، دیپفیکها هستند که میتوانند برای اهداف مخرب مانند اطلاعات نادرست، آزار و اذیت یا کلاهبرداری مورد سوءاستفاده قرار گیرند. این فناوری با دشوار کردن تمایز بین محتوای واقعی و ساختگی، اعتماد عمومی به رسانهها و اطلاعات را تضعیف میکند و بهطور نامتناسب گروههای آسیبپذیر، به ویژه زنان و اقلیتها را هدف میگیرد.

علاوه بر این، چارچوبهای قانونی موجود برای همگام شدن با توسعه سریع این فناوری کافی نیستند، هرچند برخی حوزههای قضایی اقدام به قوانین محدودکننده برای دیپفیکهای سیاسی و جنسی کردهاند.

هزینه محاسباتی بالای آموزش GANهای پیشرفته، که ممکن است هزاران دلار برای هر مدل باشد، یک شکاف دسترسی ایجاد میکند و تعداد افرادی که میتوانند از این فناوری استفاده کنند را محدود کرده و قدرت را در دست شرکتها و مؤسسات تحقیقاتی بزرگ با بودجه کافی متمرکز میسازد.

۶.۳. مسیرهای آینده

تحقیقات آینده در زمینه GANها همچنان بر حل چالشهای پایداری، تنوع و ارزیابی متمرکز خواهد بود. این شامل:

- بررسی معماریهای نوین،

- بهبود توابع زیان،

- توسعه روشهای آموزشی مقیاسپذیر و قویتر است.

همچنین کاربردهای جدیدی مانند تولید تصویر از متن و تولید ویدئو در حال رشد هستند. روندهای اخیر نشاندهنده حرکت به سمت GANهای شرطی (Conditional GANs) هستند که با دادههای محدود آموزش دیدهاند و بر تطبیق GANها با محدودیتهای دنیای واقعی تمرکز دارند. این امر نشان میدهد که آینده این حوزه تنها در ساخت مدلهای بزرگتر نیست، بلکه در توسعه مدلهای هوشمندتر، کارآمدتر و تخصصی برای کاربردهایی است که در آنها دادهها اغلب کمیاب و سازماندهی نشده هستند.

۷. نتیجهگیری

۷.۱. خلاصه یافتهها

شبکههای عصبی مولد رقابتی یک پیشرفت بنیادین در مدلسازی مولد را نشان میدهند و مدلهای چگالی صریح سنتی را با یک چارچوب رقابتی ضمنی و ظریف جایگزین میکنند. در حالی که در ابتدا با ناپایداریهای آموزشی و فروپاشی مُد دست و پنجه نرم میکردند، این حوزه با مجموعهای از راهحلهای نوآورانه پاسخ داد—از محدودیتهای معماری در DCGANs تا پیشرفتهای نظری WGANs و آموزش روشمند ProGANs. این نوآوریها، سودمندی GANs را به طیف گستردهای از حوزهها، از خلق هنر واقعگرایانه تا غنیسازی مجموعههای داده پزشکی حیاتی، گسترش دادهاند. تکامل این فناوری از مدلهای غیرشرطی به شرطی و از جفتشده به بدون جفت، تلاشی مستمر برای غلبه بر محدودیتهای عملی و گسترش کاربرد آن را منعکس میکند.

۷.۲. سخن پایانی

شبکههای عصبی مولد رقابتی چشمانداز هوش مصنوعی مولد را متحول کردهاند، اما مسیر آنها هنوز به پایان نرسیده است. چالشهای حلنشده در ارزیابی عینی و پیامدهای اخلاقی عمیق فناوری دیپفیک به عنوان جبهههای تحقیقاتی کلیدی باقی ماندهاند. این حوزه باید به توازن بین پیگیری قابلیتهای مولد هرچه واقعگرایانهتر با توسعه حفاظهای قوی و چارچوبهای اخلاقی برای تضمین استفاده مسئولانه از این فناوری ادامه دهد. به عنوان یک فناوری بنیادین، GANs قبلاً قدرت عظیم خود را نشان دادهاند، و مسیر آینده آنها همچنان توانایی ما را در خلق و تعامل با واقعیتهای دیجیتال مصنوعی شکل خواهد داد.